1. 서 론

2. 관련 연구

2.1. 센서 차단 데이터셋 생성

2.2. 영상인식 기반 차선 인식

2.3. 딥러닝 기반 차선 인식

3. 연구 방법

3.1. 폭우 상황 센서 차단 생성 방법

3.2. 가상환경 데이터셋 생성

3.3. 차선 인식 모델 적용

4. 실험 및 연구 결과

4.1. 데이터셋 구성

4.2. 평가 지표

4.3. 결과 비교 분석

4.4. 고찰

5. 결 론

1. 서 론

자율주행 기술은 최근 수십 년 동안 급속히 발전해왔으며, 차선 유지, 자율 비상 제동 시스템, 충돌 회피 등과 같은 다양한 주행 시나리오에서의 적용을 위한 많은 연구와 관심이 증가하고 있다.(1) 최근에는 레벨 4 자율주행 기술의 개발이 활발하게 이루어지고 있으며, 레벨 5 기술로의 발전을 목표로 연구와 산업계의 노력이 집중되고 있다.(2~4) 이러한 자율주행의 레벨에서는 차량의 출발부터 도착까지 마주하는 다양한 주행 상황에 성공적으로 대처해야 하는데, 그중에서 빈번하게 일어나는 문제는 기상 조건으로 인한 센서 차단 현상이다.(5~7) 특히, 차선 인식과 객체 인식과 같은 여러 응용 기술들은 데이터셋의 도메인과 품질에 크게 영향을 받는 심층 신경망(DNN)을 기반으로 개발되었다.

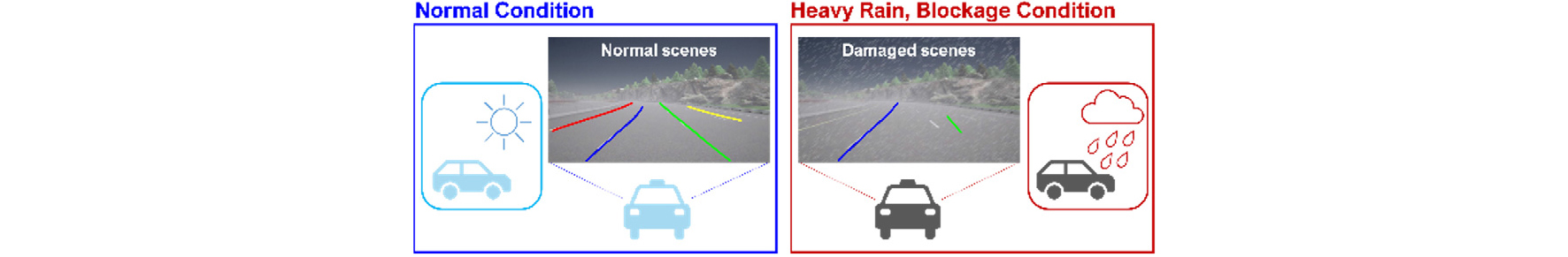

다양한 응용 분야 중에서도 차선 인식은 자율주행 차량의 핵심 기술로, 차선 유지, 스마트 크루즈 컨트롤, 차선 변경 등에 광범위하게 활용된다. Fig. 1은 자율주행 차량이 차선 인식 과정에서 겪는 센서 차단 문제의 전형적인 도전 과제를 보여준다. 왼쪽 이미지는 맑은 날씨의 정상적인 조건을 나타내며, 오른쪽 이미지는 폭우로 인한 차단 조건을 설명한다. Fig. 1에서 볼 수 있듯이, 폭우 상황에서는 카메라 센서를 기반으로 한 인식 알고리즘에 필요한 도로 장면을 획득하는 데 어려움이 발생한다. 악천후 조건에서 획득된 손상된 이미지는 자율주행 중 차선 인식의 오탐지나 실패를 초래할 가능성이 높으며, 잘못된 차선 정보로 인해 발생한 잘못된 경로에서 다른 차량이나 보행자가 있을 경우 심각한 사고로 이어질 수 있다.

이처럼 자율주행 차량의 센서 차단 문제에 대한 연구가 필요함에도 불구하고, 악천후 조건에서 센서 성능 저하로 인한 안전 문제는 대체로 간과되어 왔다. 일부 연구자들은 센서 차단 문제를 정성적으로만 분석하고,(8~10) 양적인 결과 없이 예측 가능한 결과만을 논의하였다.(11) 이러한 센서 차단 연구의 문제는 다양한 기상 조건을 조정하기 어렵고, 실제 환경에서 이러한 조건 하에서 실험을 수행하는 것은 사고의 위험 때문에 매우 어려운 현실 때문이다.(9,12) 향후 이 연구 분야의 개발자들은 새로운 신경망을 개발하여 실질적인 해결책을 제시하기 위해 방대한 양의 고품질 데이터를 필요로 할 것이다. 그러나 실제 환경에서 유용한 데이터를 얻는 것은 매우 어렵다. 그에 대한 가능한 해결책 중 하나는 가상 시뮬레이션 환경에서 쉽게 반복적으로 얻을 수 있는 합성 데이터셋을 활용하는 것이다.(13)

자율주행 차량의 센서 차단 문제에 대한 연구의 어려움을 고려하여, 본 논문에서는 폭우 운전 장면이 포함된 유용한 가상 데이터셋을 생성하고, 다양한 폭우 장면에서 차선 인식 알고리즘의 성능을 평가하는 것을 목표로 한다. 따라서 우리는 CARLA 시뮬레이터에서 얻은 새로운 데이터셋과 이를 활용한 차선 인식 평가 형식을 제안한다. 다양한 강우량에 따라, 전통적인 방법과 DNN 기반 방법 모두를 사용하여 손상된 도로 장면에서 차선 인식 알고리즘을 구현하였다. 본 논문의 주요 기여는 다음과 같다:

∙ 본 연구는 고속도로 시나리오에서 직선 차선과 곡선 차선을 포함한 다양한 도로 조건에서 폭우로 인한 악천후 조건 하에서 자율주행 차량의 이미지 기반 심층 신경망 차선 인식 알고리즘의 성능 저하를 철저히 정량화하였다.

∙ 딥러닝 기반의 차선 인식 방법을 평가하기 위해 CARLA 시뮬레이터에서 생성된 고속도로 장면을 사용하여 합성 센서 차단 차선 데이터셋을 생성하였으며, 0 mm/h에서 100 mm/h에 이르는 다양한 강우량을 가진 라벨링이 완료된 검증 데이터셋을 제공하였다.

∙ 실험적으로 얻은 강우 방정식을 기반으로 손상된 도로 이미지를 사용하여 최신 DNN 기반 차선 인식 방법과 전통적인 인식 방법의 성능을 비교하였다.

∙ 비교 평가 결과를 바탕으로 전통적인 방법과 현재 개발된 DNN 기반 방법의 장점을 인정하며, 자율주행 차량의 센서 차단 문제를 해결하기 위한 하이브리드 차선 인식 접근법의 가능성을 논의하였다.

2. 관련 연구

2.1. 센서 차단 데이터셋 생성

자율주행에 대한 평가 환경은 가상 센서 데이터를 중심으로 개발되어 왔다. SYNTHIA(14)와 Synscapes(15)는 자율주행에서의 의미론적 분할, 도메인 적응, 기타 응용 프로그램을 위한 학습 및 평가에 사용되는 대표적인 합성 데이터셋이다. 최근에는 자율주행 차량의 다양한 모듈(즉, 인지, 계획, 제어)을 테스트할 수 있는 여러 플랫폼이 등장하였다. CARLA,(16) LGSVL,(17) AirSim(18)과 같은 오픈소스 시뮬레이터들이 그 예이다. 이들 시뮬레이터는 RGB 이미지, 깊이 이미지, 포인트 클라우드와 같은 시각적 데이터뿐만 아니라 계획 및 제어 알고리즘의 구현도 제공한다.

또한, 이 프로그램들은 사용자가 내부 매개변수를 쉽게 제어할 수 있도록 Python API를 제공하는 사용자 친화적인 특성을 갖추고 있다. 이러한 기능들은 자율주행 연구에서 주행을 위한 세 가지 모듈의 편리한 연결성을 제공하여 연구를 촉진할 수 있다.

2.2. 영상인식 기반 차선 인식

현재까지 이미지 처리 기술을 기반으로 한 많은 차선 인식 방법이 개발되었다. 이러한 방법들은 주로 엣지 추출과 같은 이미지 처리 기법을 통해 시각적 특징을 활용하였다.(19) 입력으로 사용되는 원본 이미지의 품질을 향상시키기 위해, 투시 변환 및 히스토그램 분석이 적용되어 차선 픽셀의 정확한 위치를 파악하는 데 사용되었다.(20)

2.3. 딥러닝 기반 차선 인식

차선을 표현하기 위한 방법으로, 다양한 접근법을 통해 합성곱 신경망(CNN) 기반의 탐지 알고리즘이 연구되어 왔다. 대표적인 방법으로는 분할 기반 방법과 앵커 기반 방법이 있다.

현재의 차선 인식 알고리즘은 일반적으로 픽셀 단위 예측을 사용하는데, 이는 분할 기반 방법을 의미한다. SCNN은 도로 차선에서 명확한 공간적 관계를 포착하는 강력한 방법을 가진 알고리즘으로,(21) 시뮬레이션 환경에서 높은 성능의 차선 인식을 달성하였으나 긴 실행 시간으로 인해 실시간 차선 인식에는 적용되지 못했다. SCNN을 이어, RESA는 입력 이미지로부터 전역적인 특징을 활용하는 신뢰할 만한 방법으로 제안되었다.(22) 그러나 분할 기반 방법은 매번 추론 시 픽셀 단위 예측을 수행하므로 학습 및 테스트 시간이 길어지는 단점이 있다.

앵커 기반 방법으로는, UFLD가 각 행의 차선의 수평 위치를 나타내는 사전 정의된 행 앵커를 사용하는 접근법을 제안하였다.(23)이 방법은 입력 이미지에 그리딩을 적용하고 경량화된 백본을 사용하여 추론 속도를 개선하였다. LaneATT는 높은 효율성과 추론 성능을 향상시킨 또 다른 앵커 기반 방법이다.(24) 이들 방법은 공통적으로 짧은 실행 시간과 높은 정확도의 탐지를 만족시키는 추론 성능을 개선하였다.

3. 연구 방법

3.1. 폭우 상황 센서 차단 생성 방법

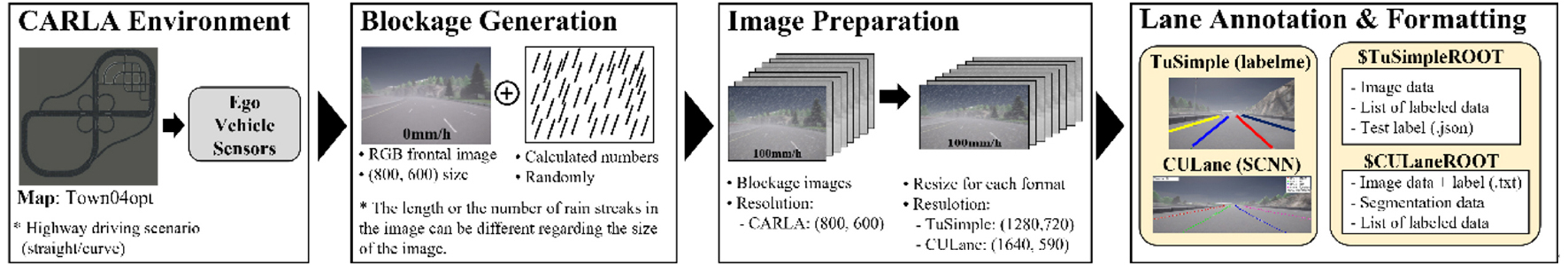

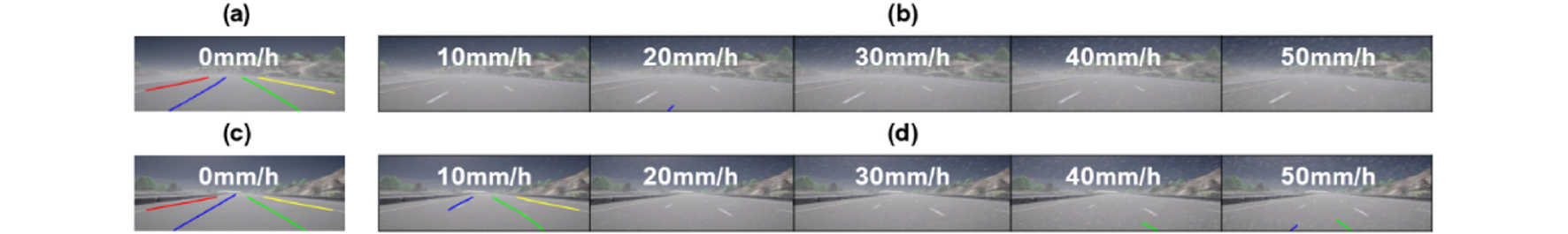

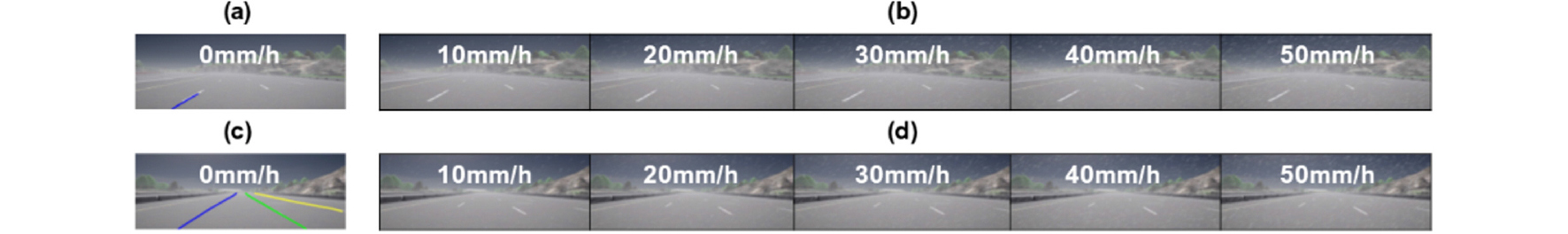

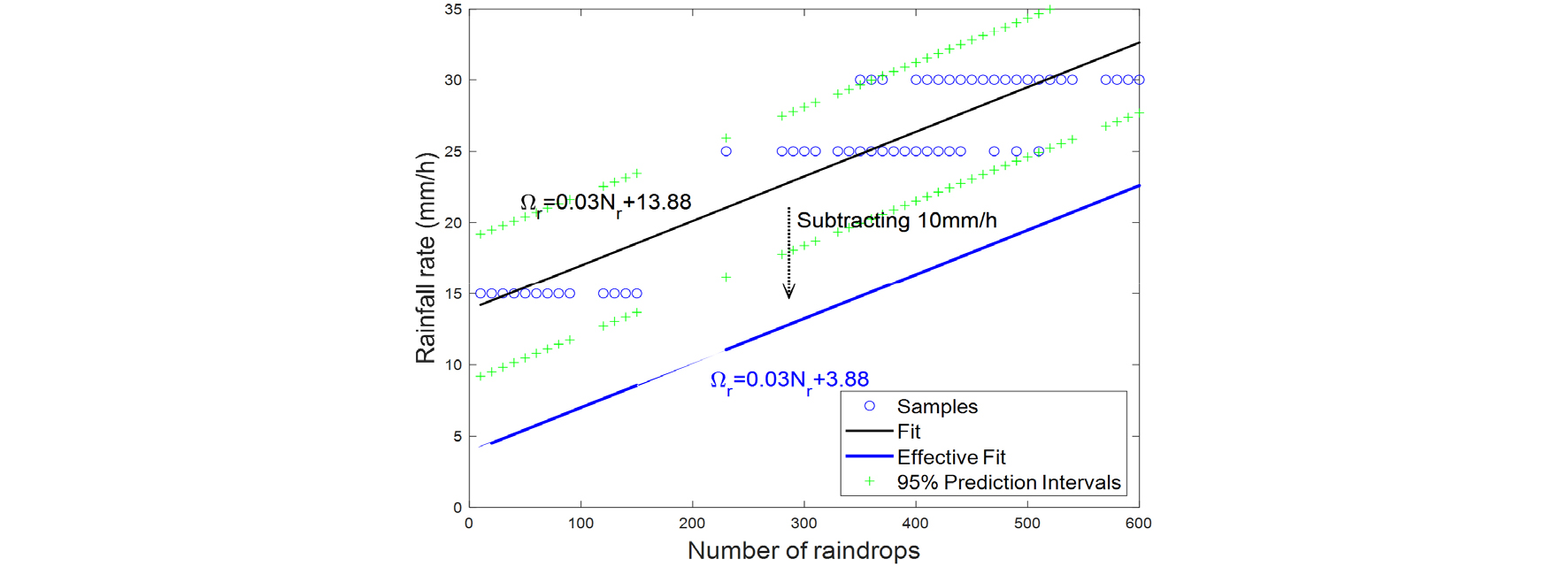

Fig. 2에 보인 바와 같이, 가상 센서 차단 차선 데이터셋을 생성하기 위해 CARLA 시뮬레이터에서 합성 차단 이미지를 제작하였다. 이 이미지는 CARLA의 Town04opt맵에서의 주행 장면에서 얻어진 것으로, 고속도로 주행 시나리오를 나타낸다. 원본 RGB 이미지가 획득된 후, 차단 생성 모듈은 Fig. 3에 제시된 실험적 강우 방정식을 기반으로 계산된 강수량에 따라 원본 이미지에 무작위로 빗줄기 효과를 추가한다.(25) 해당 연구에서는 강우량과 비구름의 개수 사이의 관계를 도출하였다.

Fig. 3

The experimental rainfall equation upon the number of raindrops with 95% confidence level. R squared score of the regression results of 0.84(25)

3.2. 가상환경 데이터셋 생성

실제 비 오는 이미지와 합성된 차단 이미지 간의 상관관계에 대한 기존 정보를 바탕으로, 차선 인식 방법 평가에 사용될 손상된 도로 이미지를 준비하였다.

DNN 기반 차선 인식 알고리즘의 편리한 추론을 위해 합성 이미지와 데이터셋 구조는 수정되어야 한다. CARLA 시뮬레이터에서 얻어진 이미지 크기는 (800, 600)이며, TuSimple 데이터셋과 CULane 데이터셋에 맞추어 각각 (1280, 720)과 (1640, 590) 크기로 resize되었다. resize된 후 각 데이터셋에 대한 차선 주석 절차를 진행하였다. TuSimple 형식의 주석을 위해서는 오픈소스 라벨 도구인 labelme를 사용하였고, CULane 형식의 경우, CULane 데이터셋을 제안한 SCNN 개발자들의 github 주석 규칙을 따랐다. 우리는 Python 코드로 작성된 CULane 라벨 도구의 수정된 버전을 사용하였다.(26) 주석 작업 중에는 두 점 사이에서 반복적인 선형 맞춤 방식을 사용하였으며, 각 차선 라벨에는 여러 쌍의 점들이 존재하였다. 각 쌍은 균등하게 간격을 나눈 점들로 분할되었으며, 이를 통해 수작업으로 발생할 수 있는 오류를 줄였다.

3.3. 차선 인식 모델 적용

센서 차단 조건에서의 성능을 평가하기 위해 전통적인 방법과 DNN 기반 방법을 포함한 차선 인식 방법을 동시에 구현하였다. 전통적인 방법으로는 투시 변환과 히스토그램 분석 알고리즘이 적용되었으며, 이는 이미지 처리 기반 방법 중 하나로 현재 널리 사용되는 방법이다.(20) DNN 기반 방법으로는 UFLD(23)와 LaneATT(24)가 높은 추론 속도를 고려하여 평가 대상 후보로 선정되었다. 센서 차단 문제를 해결하기 위한 강우 제거(de-raining)와 같은 다른 실용적인 솔루션들은 추가적인 추론 시간이 요구될 수 있기 때문에, 우리는 상대적으로 빠른 속도를 가진 차선 인식 알고리즘을 선택하여 이들 방법의 한계를 검증하고자 하였다. 이전 연구에서는 80 mm/h에서 100 mm/h에 이르는 극한 폭우 조건에서 전통적인 차선 인식 방법의 성능이 저하된 것으로 나타났다.(25) 차선 인식에 관한 조사 논문에 따르면, DNN 기반 알고리즘이 기상 조건에 대해 더 견고할 것으로 예상되었으며, 따라서 강우량이 80 mm/h를 초과할 때 성능이 약간만 저하될 것이라고 기대하였다.

4. 실험 및 연구 결과

4.1. 데이터셋 구성

학습 데이터셋으로는 TuSimple과 CULane 데이터셋을 사용하였다. TuSimple은 고속도로 차선 데이터셋으로, 해상도는 (1280, 720)이며, 3626개의 학습용 이미지, 358개의 검증용 이미지, 2782개의 테스트용 이미지로 구성되어 있다.(27) CULane은 도시 도로 차선 데이터셋으로, TuSimple보다 훨씬 크며 총 133,235개의 프레임으로 이루어져 있다. 이 프레임들은 88,880개의 학습용, 9,675개의 검증용, 34,680개의 테스트용 데이터셋으로 나누어진다.(21) 테스트 데이터셋은 다양한 도로 조건에 따라 나누어져 있으며, TuSimple은 우리 테스트 데이터셋과 유사한 특성을 가진다.

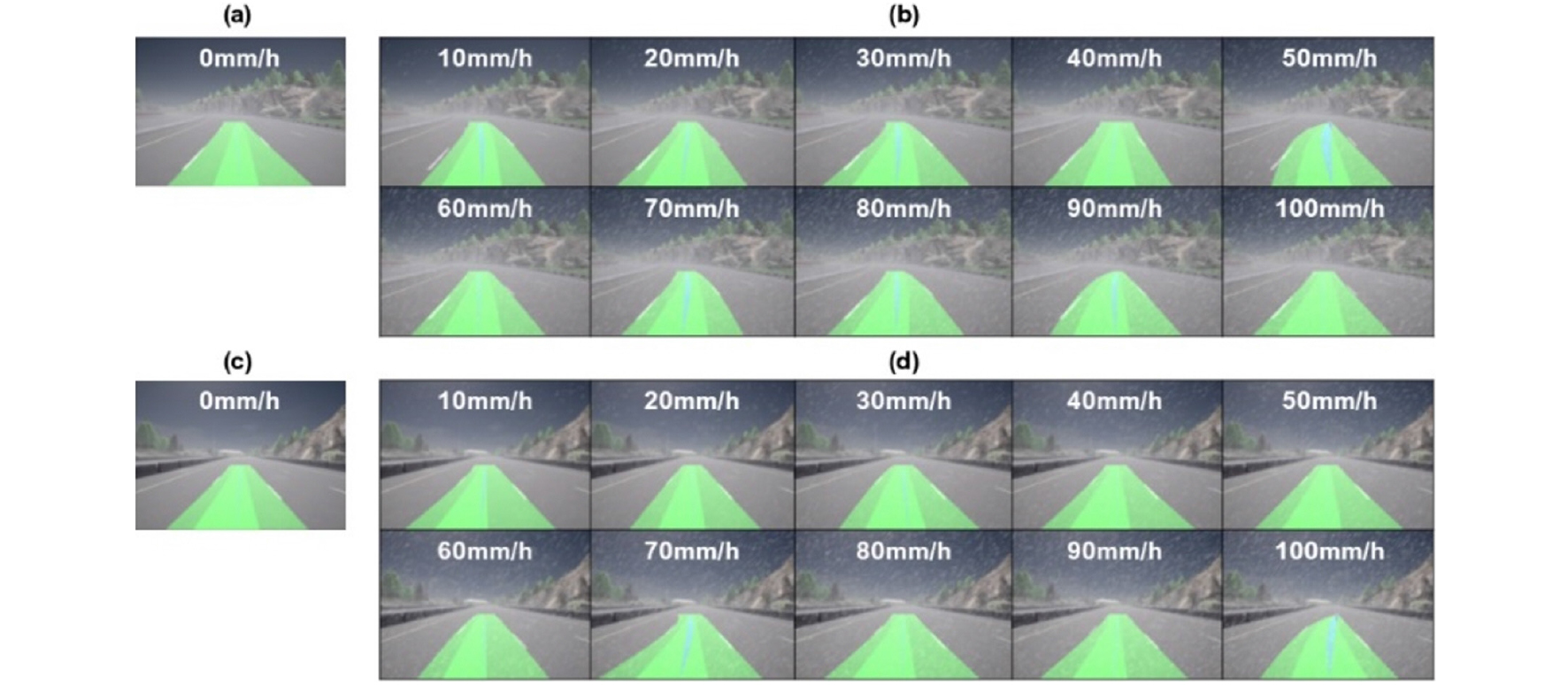

테스트 데이터셋으로는 CARLA 시뮬레이션 환경에서 얻은 CARAIN(CARLA + Rain) 데이터셋을 제안한다. 이 데이터셋은 실험적 강수 방정식을 이용해 계산된 특정한 비구름 개수로 합성되었다. 현재 이 데이터셋은 테스트 데이터셋만을 포함하고 있다. 다양한 형식의 데이터셋 평가를 위해 여러 해상도가 제공되며, 이는 Table 1에 나타나 있다. 제안된 테스트 데이터셋은 각 강수 범위마다 직선 차선 75프레임, 곡선 차선 90프레임(총 165프레임)으로 구성되어 있다. 강수량 범위는 0 mm/h에서 100 mm/h까지이며, 10 mm/h 간격으로 구성된다. 이 이미지는 고속도로 시나리오에서 얻어졌으며 대부분이 비 오는 주행 장면을 포함한다. 또한, 이 데이터셋은 TuSimple 및 CULane 형식의 주석 파일도 제공하여 연구자들이 이 가상 비 주행 데이터셋을 사용해 차선 인식 방법을 적용하고 알고리즘의 성능을 평가할 수 있도록 하였다.

Table 1.

Description of lane datasets

4.2. 평가 지표

위에서 언급된 다양한 방법들의 성능을 평가하기 위해, 우리는 두 가지 일반적인 학술적 벤치마크 데이터셋 형식인 TuSimple 차선 인식 벤치마크와 CULane 데이터셋을 사용하여 실험을 진행하였다. 각 DNN 모델의 학습 도메인이 각각 TuSimple과 CULane이므로, 우리는 소스 도메인과 타겟 도메인에 맞춰 테스트 절차를 수행하였다 즉, TuSimple의 양식으로 수정된 제안된 데이터셋으로 학습된 경우 실제 TuSimple 데이터셋에서 평가를 진행하였다.

평가 지표로는 TuSimple과 CULane에서 두 가지의 서로 다른 지표를 사용하였다. TuSimple의 경우, 정확도(Accuracy) 지표가 사용되며, 이는 다음 식 (1)로 계산된다.

여기서 은 예측한 차선 포인트 중 정확하게 예측된 개수를 나타내고, 은 각 클립에서의 실제 차선 포인트(ground truth)의 총 개수를 의미한다.(27) CULane의 경우, 각 차선은 너비 30픽셀의 선으로 간주되며, 그 후 실제 차선과 예측 차선 간의 교차영역비율(IOU)을 계산한다. 예측된 차선의 IOU가 0.5, 즉 IOU 임계값보다 크면, 해당 차선은 참 양성(true positive, TP)으로 기록된다. 또한, TP와 함께 거짓 양성(false positive, FP)과 거짓 음성(false negative, FN)도 정확도(precision)와 재현율(recall)을 계산하는 데 사용된다. 이러한 값들을 이용하여 F1-measure를 식 (2)로 구할 수 있다.

여기서 , 를 의미한다.

평가를 위해 본 방식에서는 차선 포인트가 있는 행 앵커(row anchors)를 사용하였다. TuSimple의 경우, 행 앵커는 160에서 710까지 10 간격으로 배치되었고, CULane에서는 260에서 580까지 동일한 간격으로 배치되었다. 이는 각각의 데이터셋에서 정의된 형식과 상관관계가 있다. 최적화 과정에서는 Adam 옵티마이저를 사용하여 UFLD 학습 지침에 따라 코사인 감쇠 학습률 전략을 적용하였다.(23) TuSimple 데이터셋의 경우 총 100 에폭 동안 학습하였고, 배치 크기는 32였다. CULane의 경우, 총 50 에폭 동안 학습이 진행되었다. 모든 모델은 ResNet 백본의 레이어를 제외하고 동일한 설정으로 학습되었다. 모델의 최적화 및 평가는 PyTorch 프레임워크와 NVIDIA사의 RTX 3080Ti GPU에서 수행되었다.

4.3. 결과 비교 분석

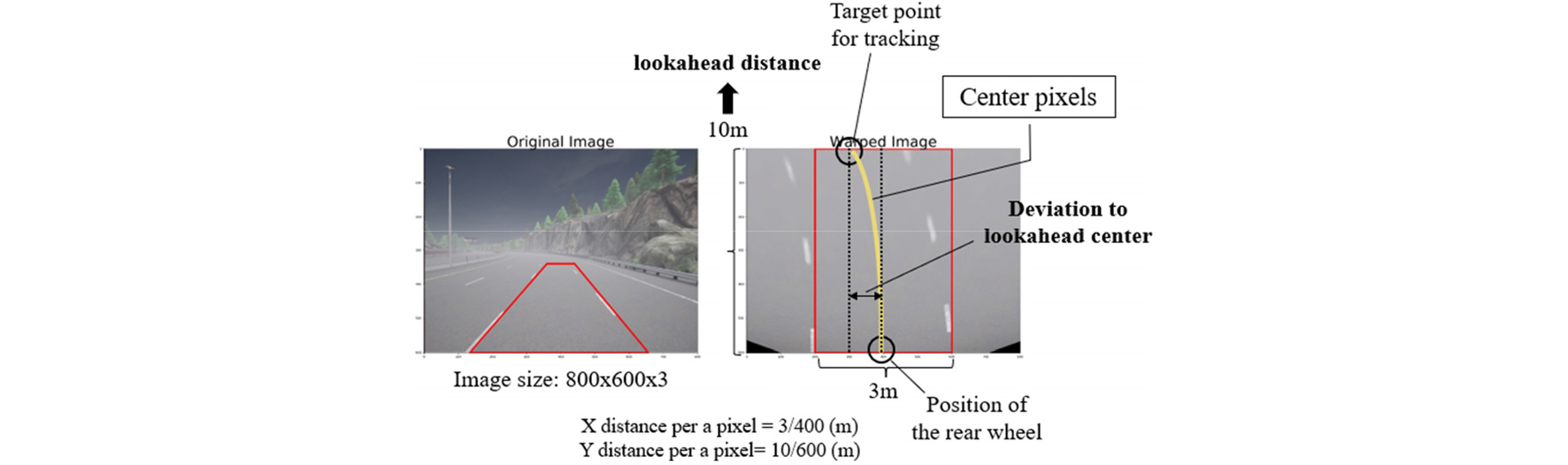

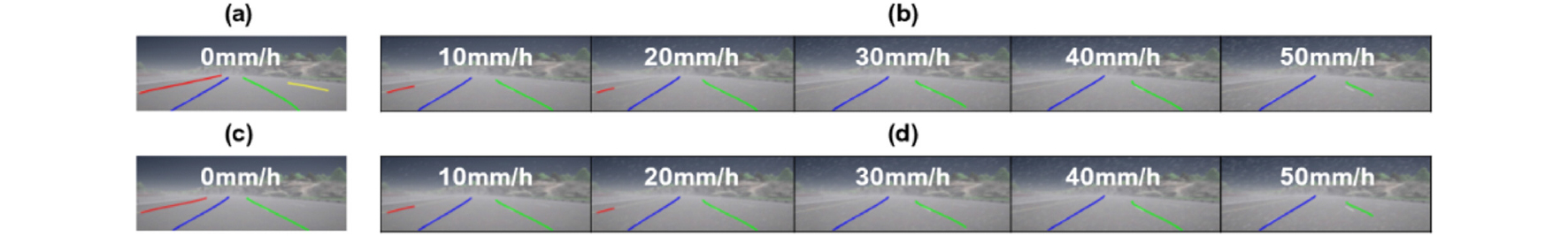

Fig. 4에 나타난 바와 같이, 전통적인 방법은 순수 추종 방식(pure pursuit method)을 통해 계산된 특정 프레임에서의 조향 각도로 평가되었다.(25,28) Table 2와 Table 3은 직선 및 곡선 차선 시나리오에서 폭우 조건하의 조향 각도 결과를 보여준다. 강우량이 80 mm/h 이상일 때, 두 시나리오에서 자율 주행 차량은 매우 위험한 조향 명령을 생성하였다. 곡선 시나리오에서 최대 값은 6.5407°였으며, 같은 시나리오에서의 RMSE는 2.3521°였다. 그러나 강우량이 60 mm/h 이하일 경우 간접적인 비가 차선 인식을 심각하게 방해하지 않는다는 사실을 확인할 수 있었다.

Table 2.

Analysis of RMSE, maximum error, and minimum error of steering angle, in straight scenario

| Metrics | Rainfall rate (mm/h) | |||

| 20 | 50 | 80 | 100 | |

| RMSE (°) | 0.2437 | 0.4766 | 0.6326 | 1.1218 |

| Max. error (°) | 0.9635 | 1.8771 | 2.2721 | 4.1186 |

| Min. error (°) | 0 | 0 | 0 | 0 |

Table 3.

Analysis of RMSE, maximum error, and minimum error of steering angle, in curve scenario

| Metrics | Rainfall rate (mm/h) | ||||

| 20 | 40 | 60 | 80 | 100 | |

| RMSE (°) | 0.6830 | 0.8761 | 1.0336 | 1.3059 | 2.3521 |

| Max. error (°) | 3.6036 | 3.0105 | 3.6285 | 4.0752 | 6.5407 |

| Min. error (°) | 0 | 0 | 0 | 0 | 0.0493 |

Table 4와 Table 5에 나타난 바와 같이, DNN 기반 방법들은 TuSimple과 CULane 데이터셋 형식에서 평가되었다. UFLD는 ResNet34 백본을 사용할 때 가장 좋은 성능을 보였으며, ResNet18 백본에서는 가장 낮은 성능을 보였다. LaneATT 역시 대부분의 강우량에서 ResNet34 백본을 사용할 때 가장 좋은 성능을 보였으며, ResNet18 백본에서는 가장 낮은 성능을 보였다.

Table 4.

Results of current lane detection networks on CARAIN dataset. Models are trained on TuSimple dataset. The evaluation metric is accuracy

Table 5.

Results of current lane detection networks on CARAIN dataset. Models are trained on CULane dataset. The evaluation metric is F1 measure when the IOU threshold is 50 pixels

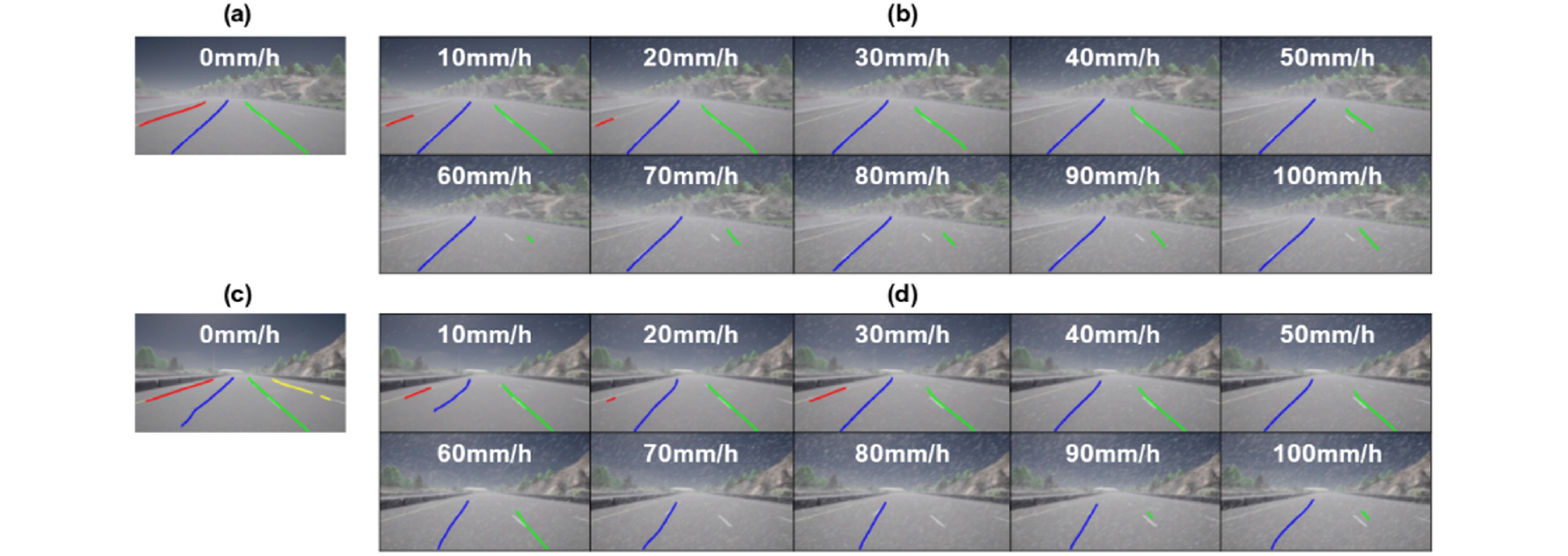

학습 도메인이 CULane일 경우, 두 DNN 모델 모두 강우량이 10 mm/h일 때도 차선 인식에 거의 실패하였다. F1 점수가 0인 경우, 이는 모델이 차선을 전혀 제대로 인식하지 못했다는 것을 의미한다. 따라서 CULane에서의 60 mm/h 이상의 강우량 구간에 해당하는 일부 정성적 이미지 결과는 제공하지 않기로 결정하였다. 시연 이미지에 대한 설명과 평가 결과에 대한 우리의 통찰은 다음 소절인 4.4 고찰에서 다룰 것이다.

4.4. 고찰

4.4.1. 영상처리 기반과 심층 신경망 기반의 방식

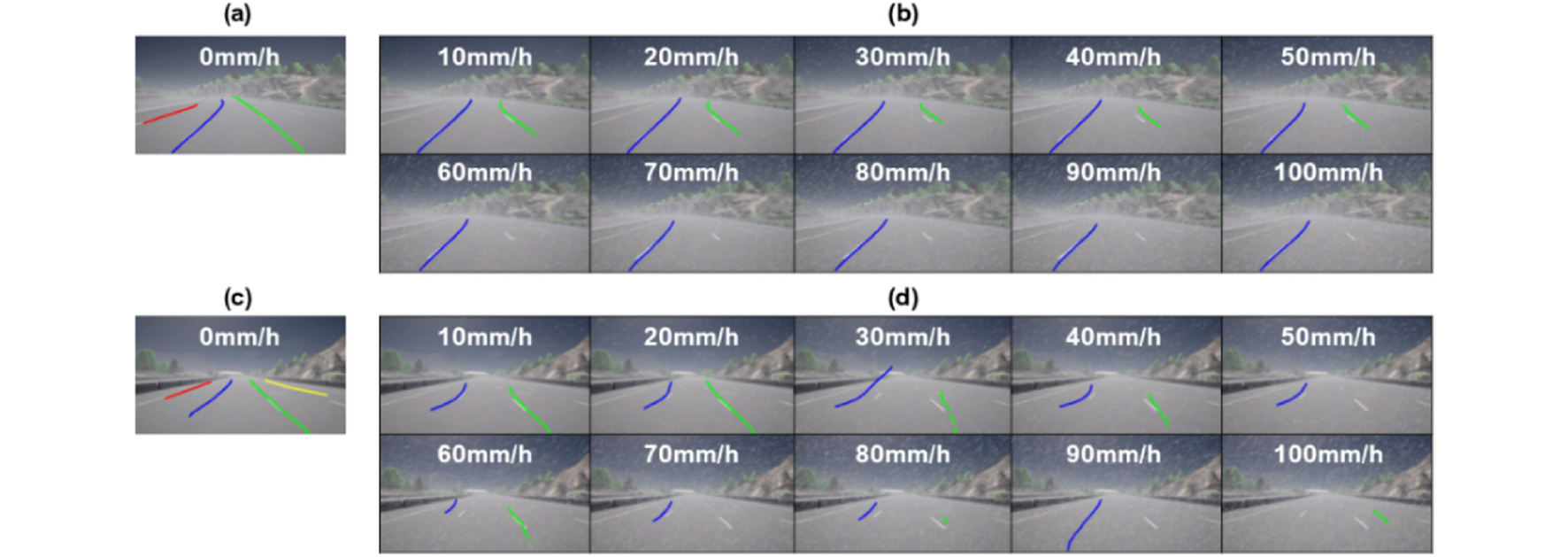

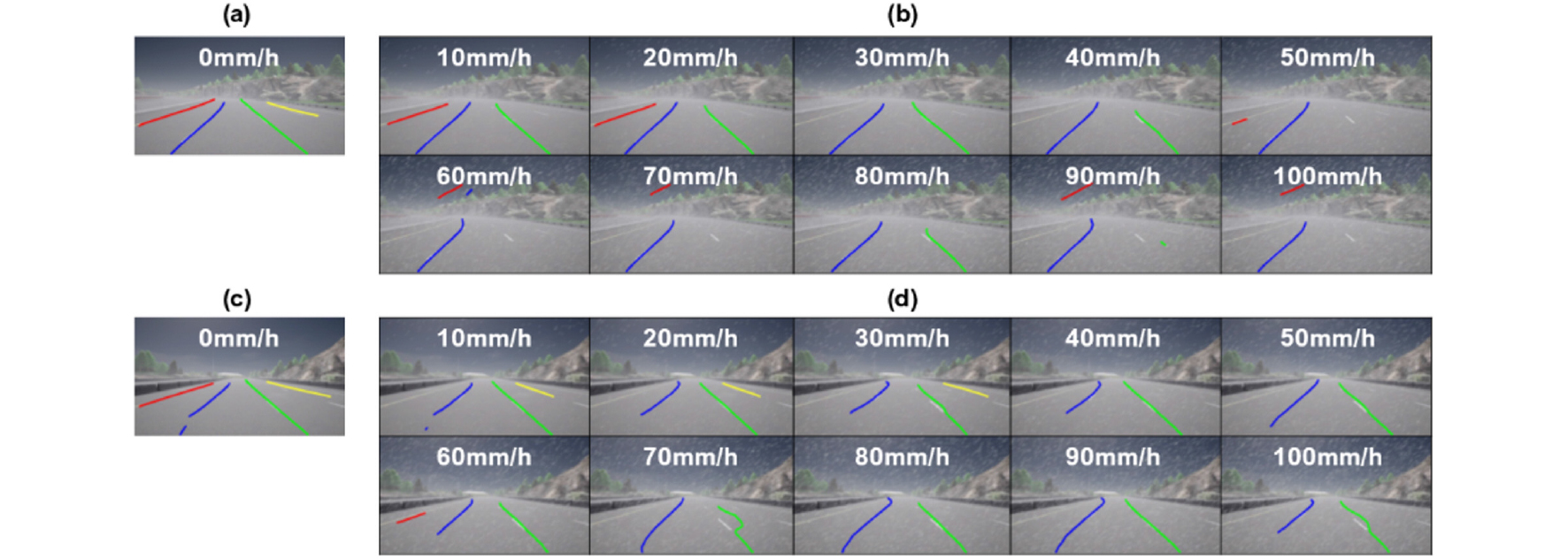

Fig. 5에서 볼 수 있듯이, 전통적인 영상인식 기반의 차선 감지 방법은 폭우 상황에서도 잘 작동하였다. 반면에, Fig. 9~11에 나타난 바와 같이, DNN 기반 차선 감지 방법들은 소량의 강우에도 성능이 크게 저하되었다. 이러한 결과는 전통적인 이미지 처리 기반 방법이 매우 높은 강우량에서도 강우의 영향을 덜 받는다는 것을 시사한다. 따라서, 하나의 가능한 해결책으로 우리는 이미지 처리의 특성을 차선 감지 네트워크 구조에 결합한 하이브리드 차선 감지 접근법의 활용 가능성을 확인하였다.

4.4.2. 도메인 차이(Domain gap)

Fig. 6~8에서 TuSimple 데이터셋으로 학습된 모델이 잘 작동한 것을 보면, TuSimple과 CARAIN의 고속도로 장면의 유사성이 도메인 변화에 미치는 부정적인 영향을 줄였다고 추론할 수 있다. DNN 기반 모델을 적용할 경우, 또 다른 가능한 해결책으로는 원본 네트워크 모델이 소스 도메인에서 학습되고 검증된 후, 타겟 도메인에서 전이 학습 방법을 사용하는 것이 될 수 있다.

5. 결 론

본 논문에서는 합성된 이미지로 생성된 센서 차단 상황에서의 차선 데이터셋인 CARAIN을 제안하였다. 이 새로운 데이터셋은 폭우로 인한 센서 차단이 발생한 프레임으로 구성되어 있으며, 실험적으로 도출된 강우 방정식을 기반으로 주행 장면에 빗줄기가 추가되었다. 이 데이터셋을 사용하여 전통적인 차선 감지 방법과 DNN 기반 차선 감지 방법을 TuSimple 및 CULane 평가 형식에서 철저히 평가하였다. 결과에 따르면 DNN 기반 차선 감지 방법이 도메인 변화에 크게 영향을 받는다는 것을 시사할 수 있었다.

향후 연구에서는 차선 감지 방법이나 이미지 변환을 위해 도메인 적응 기술을 적용할 계획이다. 또한, 이미지 처리와 데이터 기반 방법을 협력적으로 사용하여 합성된 빗속 이미지에서 차선 감지 성능을 향상시킬 수 있는지 검증하기 위해 하이브리드 차선 감지 연구를 시도할 것이다.