1. 서 론

2. 자율 주행 실험 차량 환경 구성

2.1. 자율 주행 실험 차량 센서 구성

2.2. 자율 주행 실험 데이터 취득 환경

3. 지면 분리 알고리즘

3.1. Ransac의 평면모델을 이용한 점군 추출

3.2. 점군 간 거리 기반 클러스터링

4. 알고리즘 구현 및 성능 평가

5. 결 론

1. 서 론

자율 주행 자동차에 대한 연구는 최근 몇 년 동안 크게 주목받아 왔고, 이에 따라 완전 자율 주행과 자율 주행 차량의 상용화를 목표로 하여 연구되어지고 있다. 일반적으로 자율 주행 시스템은 인지, 판단, 제어 단으로 이루어져 있다. 차량에 탑재된 센서로 주행 환경을 인지하고, 자율 주행 차량이 현재 상황에 맞추어 어떤 거동을 취해야 하는지를 판단하게 된다. 판단된 결과에 따라 차량이 취해야 하는 조향각과 가속도 등의 정보들이 출력되어 제어단의 입력으로 전달되면서 차량 움직임이 조절된다.

자율 주행 시스템에서 인지단은 가장 먼저 선행되어야 하며 판단, 제어 단의 출력에 큰 영향을 미치게 된다. 인지된 정보에 따라서 차량의 거동이 행해지기 때문에, 실제 자율 주행 자동차의 상용화 과정을 위해서는 실시간성이 보장된 주변 환경에 대한 정확한 인지 결과가 필수적으로 요구된다. 미인지와 오인지 등 인지 결과에서의 오류는 적합하지 않은 거동 계획으로 이어질 수 있고 큰 사고의 위험이 있다.(1)

일반적으로 자율 주행 자동차에 사용되는 인지 센서는 라이다, 레이더, 카메라가 있으며, 각 센서로부터 주변 환경 인지를 위한 기술들과 여러 센서 퓨전을 이용한 인지 기술들에 대한 연구가 이루어지고 있다.(2) 라이다는 사용하는 센서 사양에 따라 일반적으로 80~200m의 탐지거리를 지니며 빛의 속도를 이용하여 주변 환경을 탐지해내는 센서이다. 외부 환경에 대한 정확한 위치정보를 제공하며 제공된 점군집 데이터들을 이용하여 주변 물체들의 형상을 시각화할 수 있다.(3) 레이더의 경우 라이다보다 긴 거리에 대해 물체인식이 가능하고 특히 물체의 속도 측정, 분해각 측면에서 높은 정확도를 지니지만, 주변 환경에 대한 탐지율은 라이다의 비해 낮다. 카메라의 경우 이미지를 이용해 주변 환경 인지가 가능하지만, 2차원 이미지 형태로 이루어져 이미지 내 물체 깊이 추정이 이루어져야 한다. 이러한 레이더, 카메라의 3차원 위치 정보 부정확성에 의하여, 자차량의 이동 경로 판단과 종방향 및 횡방향 속도 제어를 위해 상대 차량들의 정확한 위치가 요구되는 자율 주행 환경에서는 라이다 센서를 기반으로 많은 연구들이 진행되고 있다.(4)

따라서 해당 연구에서는 라이다 센서만을 이용하여 환경 인지를 수행하고 땅 인지구역을 제거하는 알고리즘을 제안하였다. 라이다는 360도 회전하며 빛을 쏘는 형태로 작동하므로 라이다 주변에 위치한 여러 개체들의 형상과 땅을 포함하는 3차원 점군집 데이터 형태를 이룬다. 따라서 자율 주행 자동차에서 라이다 센서를 이용한 환경 인지를 위해서는 지면점과 비지면점을 추출해내는 과정이 필수적이다. 일정 높이 기준으로 라이다 센서의 점들을 제거할 경우에는 지면의 높이가 변화할 때 땅을 하나의 물체로 인지하게 되므로, 본 연구에서는 도로의 경사도가 존재하거나 자율 주행 차량에서 차량의 흔들림이 발생할 경우에 생성되는 지면 데이터를 제거하는 알고리즘을 기술한다.

2. 자율 주행 실험 차량 환경 구성

2.1. 자율 주행 실험 차량 센서 구성

본 연구에서 활용된 자율 주행 실험 차량은 Hyundai사의 IONIQ 전기차이며, 차량 전방과 각 면에 여러 인지 센서를 부착하여 실험 데이터를 확보하였다. 차량 전면에 부착된 Ibeo사의 LUX 4L제품과 차량 각 4면에 부착된 Velodyne사의 VLP-16제품을 포함한 라이더 센서와 레이더 센서, 카메라 센서가 부착되어 있다. 차량에 부착된 전체 인지 센서 구성도는 Fig. 1에 나타내었다. 실제 실험에서 사용한 데이터는 앞서 언급한 Ibeo, Velodyne사의 라이다 센서로, 세부적인 센서 사양 정보는 Table 1에 나타내었다. 전면과 각 4면의 라이다를 통하여 음영 구역을 제거함으로써 자율 주행 실험 차량 주변의 효율적인 환경 인지를 가능하게 하였다.

Table 1.

Sensor specifications for the test vehicle

2.2. 자율 주행 실험 데이터 취득 환경

본 연구에서 제시하는 알고리즘에 대한 검증을 위하여 서울대학교 내 주행 데이터를 확보하였다. 서울대학교는 관악산을 끼고 있어 경사도가 크거나 낮은 구간이 많다. 서울대학교에서 해발고도가 가장 낮은 구간은 56.5m, 가장 높은 구간은 189.3m로 캠퍼스 내에서 132.8m의 해발고도 차이가 존재한다. 또한 오르막길과 과속방지턱이 다수 존재하여 해당 알고리즘 실험 및 검증하기에 적합한 지형을 지닌다. 지면과 비지면의 점군집 데이터 세그멘테이션을 목표로 하여, 잦은 경사구간을 지닌 서울대학교 캠퍼스를 실험 지역으로 선정하였다.

3. 지면 분리 알고리즘

주행 환경을 살펴보기 위하여 자율 주행 차량 주변 개체들에 대한 분류가 필요하고, 이를 위한 지면 데이터 제거는 필수적이다. 지면 데이터 제거로 주변 개체 구분이 쉬워지고, 불필요한 영역을 제거하여 계산량을 감소시킬 수 있다. Region Of Interest(ROI)의 개념을 이용한 방법으로 z축의 값을 이용하여 지면점과 비지면접을 구분해내는 방법이 있다. 지표면에서부터 떨어진 거리를 z축 방향 기준으로 측정하고 제거하는 방법인데, 이 방법으로는 평면상에서는 가능하지만, 실제로 일반 주행을 할 때에는 도로의 경사도, 도로 포장 상태, 과속방지턱 등 여러 시나리오들이 존재하여 지면 데이터 제거가 온전하게 수행되지 않는다. 따라서 Random Sample Consensus(Ransac) 알고리즘을 이용하여 작은 경사를 지닌 도로에 대해서도 강건하고, 실시간성도 보장될 수 있도록 하였다.

3.1. Ransac의 평면모델을 이용한 점군 추출

Ransac 알고리즘은 점군집 데이터 내에 특정 모델이 존재한다는 가정으로 해당 모델의 파라미터를 추정하여 최적의 피팅 모델을 추출해내는 알고리즘이다. 점군집 데이터 안에서 무작위로 샘플 데이터를 뽑아 모델을 포함하는 모델 파라미터를 구하는 과정을 반복적으로 수행한다. 해당 데이터 내에서 모델의 모형에 맞추어 수행한 결과에 대해 가장 적합하다고 판단되는 점들을 반환한다. 반환된 점들의 개수가 많을 경우 모델에 대해 올바른 추정이 이루어진 것으로 분류된다. 반환된 데이터에 대한 정확도는 초기 설정한 기본 모델에 대한 오차를 바탕으로 추정된다.(5)

본 연구에서는 평면 모델을 이용하여 각 시간에 따른 점군집 데이터가 평면모델에 속하는지 아닌지를 구별해내어 그라운드 세그멘테이션을 진행하였다. 점군집 데이터는 주어진 모델의 분포에 적합한 인라이어와 모델 데이터의 분포에서 벗어난 관측값인 아웃라이어로 나뉘어지고, 해당 연구에서는 평면 모델에 해당하는 데이터들을 인라이어로 삼아 제거하였다. 제안된 알고리즘은 모델 파라미터에 대해 강건하여 아웃라이어가 많이 포함되어 있어도 정확도가 높은 장점이 있다.

3.2. 점군 간 거리 기반 클러스터링

KD Tree는 k차원 공간 점들을 구조화하는 공간 분할 자료구조이다. 다차원 공간에 대하여 점들을 탐색, 분할 작업을 수행할 때 용이하다.

본 연구에서도 지면와 비지면을 분리하는 세그멘테이션 알고리즘을 적용시킨 결과에 대하여 KD Tree를 생성하고 유클리디안 거리를 이용하여 클러스터링 작업을 수행하였다. 점군집 데이터에서 각 물체에 대한 점군집 데이터는 해당 객체에 대하여 모여있기 때문에 거리차이가 크지 않음을 활용하여 데이터 간의 거리를 계산하여 특정 거리 이하일 경우 동일 군집으로 간주한다. 인접 데이터 간 거리 차이를 구하기 위한 식은 (1)과 같다.

4. 알고리즘 구현 및 성능 평가

2.2장에서 기술한 형태의 실도로환경에서 Rosbag형식으로 이루어진 주행 데이터를 취득하였다. 취득한 데이터는 오프라인 시뮬레이션을 통해 본 연구의 알고리즘 성능 분석에 사용되었다.

Ransac알고리즘에 기반한 그라운드 세그멘테이션 알고리즘과 KD Tree를 이용한 클러스터링 알고리즘은 Linux의 ROS환경에서 구현되었고, C++를 사용해서 작성하였다. 알고리즘에 대한 성능 평가를 위해서는 Matlab을 이용하였으며, 그래프 작성 및 데이터 분석을도출하였다.

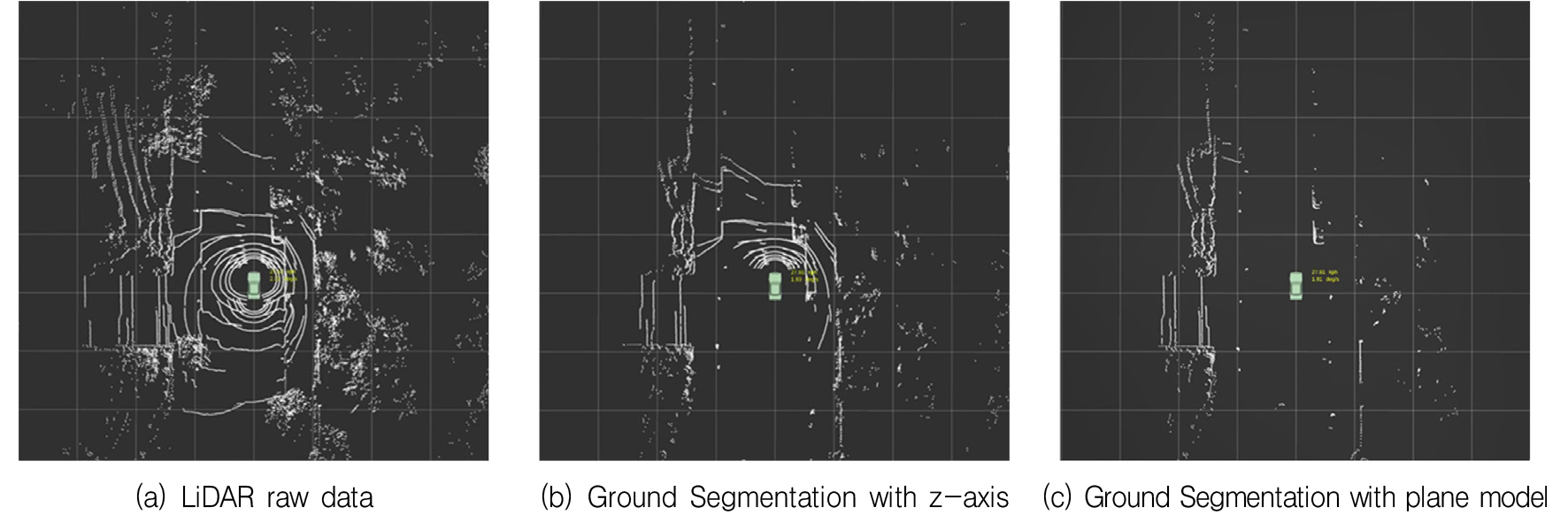

Fig. 2는 경사도의 변화를 잘 나타낼 수 있는 상황을 보이기 위해 서울대학교 캠퍼스 내의 과속방지턱을 넘은 직후 주행 상황을 나타낸 것이다. 해당 과속방지턱은 약 3.5m의 폭과 5cm의 높이를 지닌다. Fig. 2의 주행 상황에서 나타나는 라이다 점군집 데이터에 대해 z축 기준으로 지면 데이터를 분리하는 방법과 본 논문에 제시된 방법을 적용하여 Fig. 3에서 라이다 점군집 데이터 시각화를 통해 비교하였다. Fig. 3(a)의 라이다 데이터에서 z축 기준으로 지면분리를 수행한 방법에서는 Fig. 3(b)와 같이 전방의 경사도에 의해 부분적으로 지면이 추출되는 것을 볼 수 있었고, 평면 모델을 적용하였을 때는 Fig. 3(c)와 같이 지면의 라이다 점군집 데이터가 온전히 제거되고 주변 상황에 대한 물체들만을 출력해내는 것을 확인할 수 있었다.

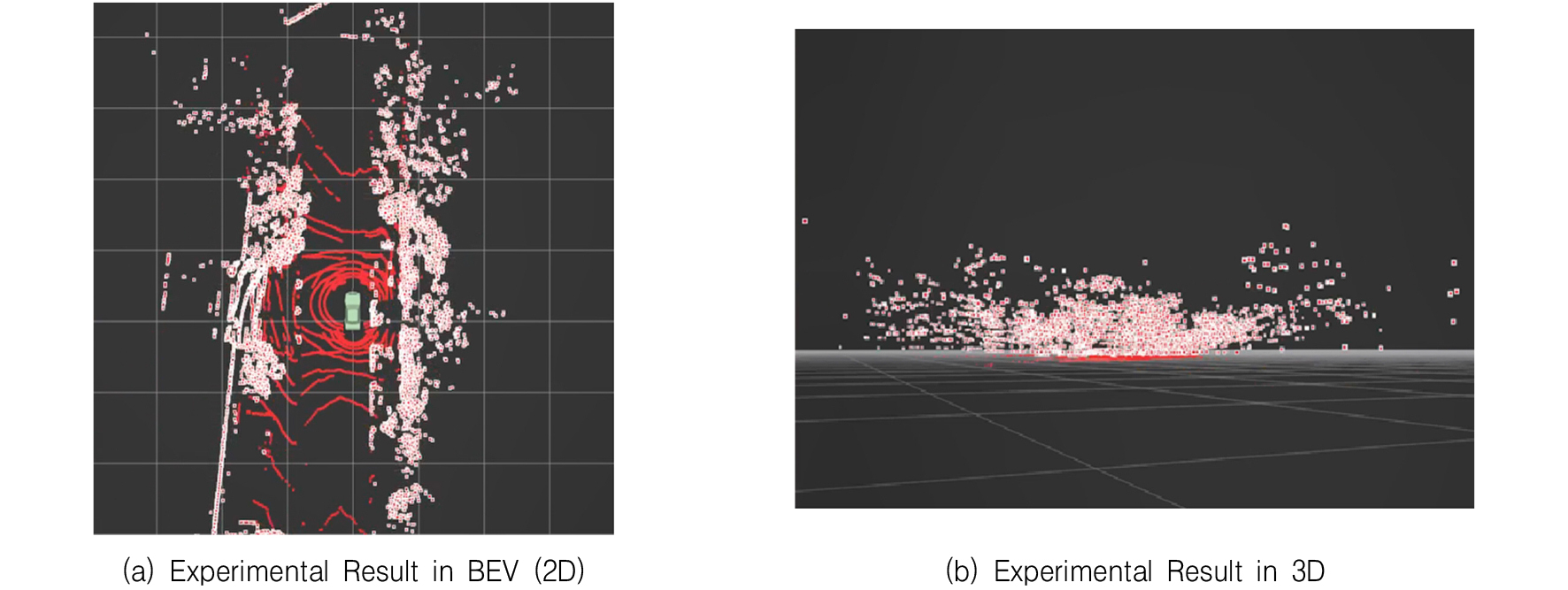

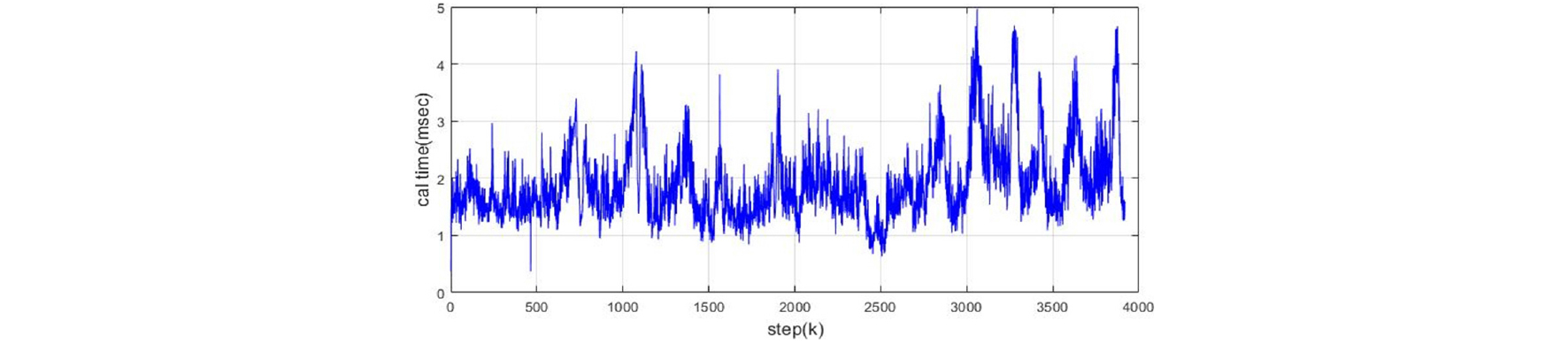

Fig. 4~5은 라이다 데이터에서 실시간으로 지면 세그멘테이션을 수행함을 보여주는 결과이다. Fig. 4에서의 붉은색 점들은 라이다 센서에서 들어온 결과를 나타내 고, 흰 점들은 알고리즘을 적용한 결과를 나타낸다. Fig. 4(a)는 두 데이터를 버드아이뷰(Bird Eye View, B EV)에서 2D형태로 나타낸 것이고, Fig. 4(b)는 두 데이터를 3D 형태로 나타낸 것이다. Fig. 4(b)에서 z=0의 값 부근의 지면 부분을 살펴보면 센서에서 전달받은 데이터로만 이루어져 있음을 확인할 수 있다. Fig. 4를 통하여 두 결과를 하나의 화면에서 시각화시킴으로써 실시간성을 육안으로 확인할 수 있고, Fig. 6에서 실시간성 확보를 위하여 제안된 알고리즘의 소요 시간을 나타내었다. Table 2에서 볼 수 있듯이 0.6643의 표준편차를 가지며 평균 1.9147초의 수행 시간이 소요되었다.

Table 2.

Statistical characteristics of algorithm execution time

| Mean | Standard Deviation | |

| Plane Model | 1.9147 | 0.6683 |

본 논문에서 제안된 알고리즘의 성능 분석을 위하여 제거되는 지면 점군집 데이터의 개수를 분석하고, 지면 데이터가 주행에 미치는 영향을 조사하기 위하여 지면 데이터가 클러스터링되어 하나의 개체로 잡히는 경우를분석하였다. 실험 데이터는 총 7840번의 스텝으로 이루어져 있으며 총 200초간의 자율 주행 데이터를 누적킨 결과이다.

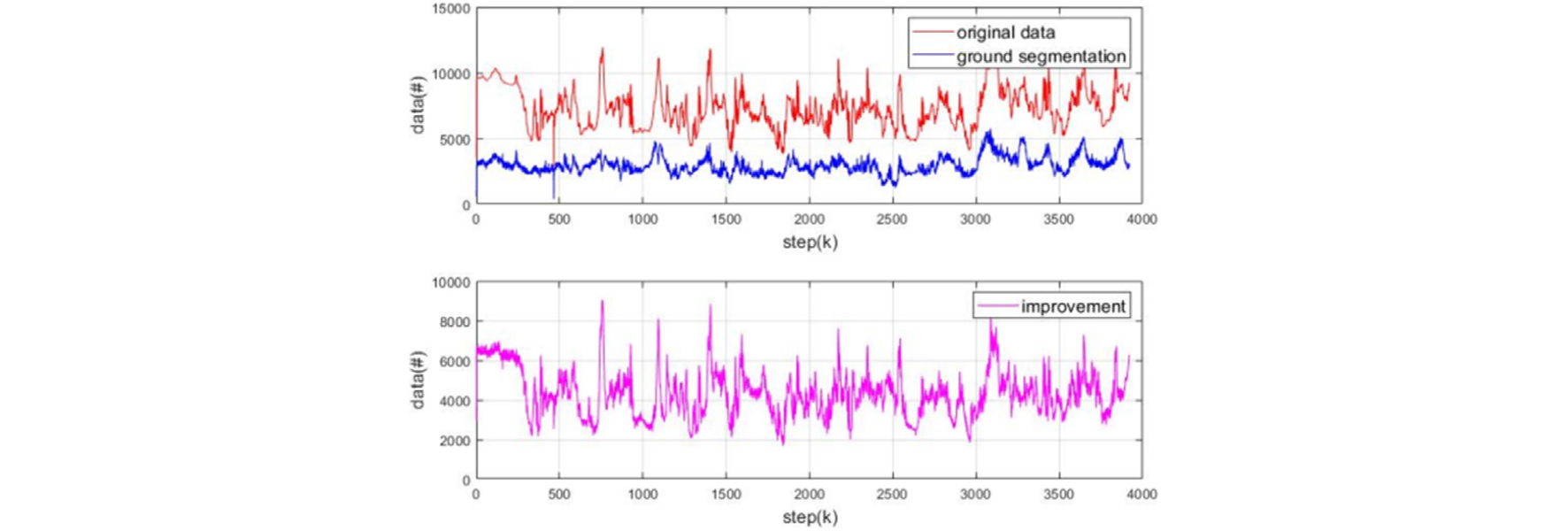

Fig. 6은 전체 라이다 점군집 데이터의 개수에 대한 그래프이다. 지면 세그멘테이션 알고리즘 적용 전후에 대한 데이터 비교 결과 Table 3에서 볼 수 있듯 약 2961.47개의 점군집 데이터들이 감소하였다. 라이다 데이터 전처리를 통하여 이후 데이터 연산량이 감소되어 실시간 처리에 도움이 됨을 알 수 있다.

Table 3.

Reduced number of valid LiDAR PCD

| Mean | Standard Deviation | |

| Original | 7288.01 | 1521.20 |

| Plane Model | 4326.54 | 1175.93 |

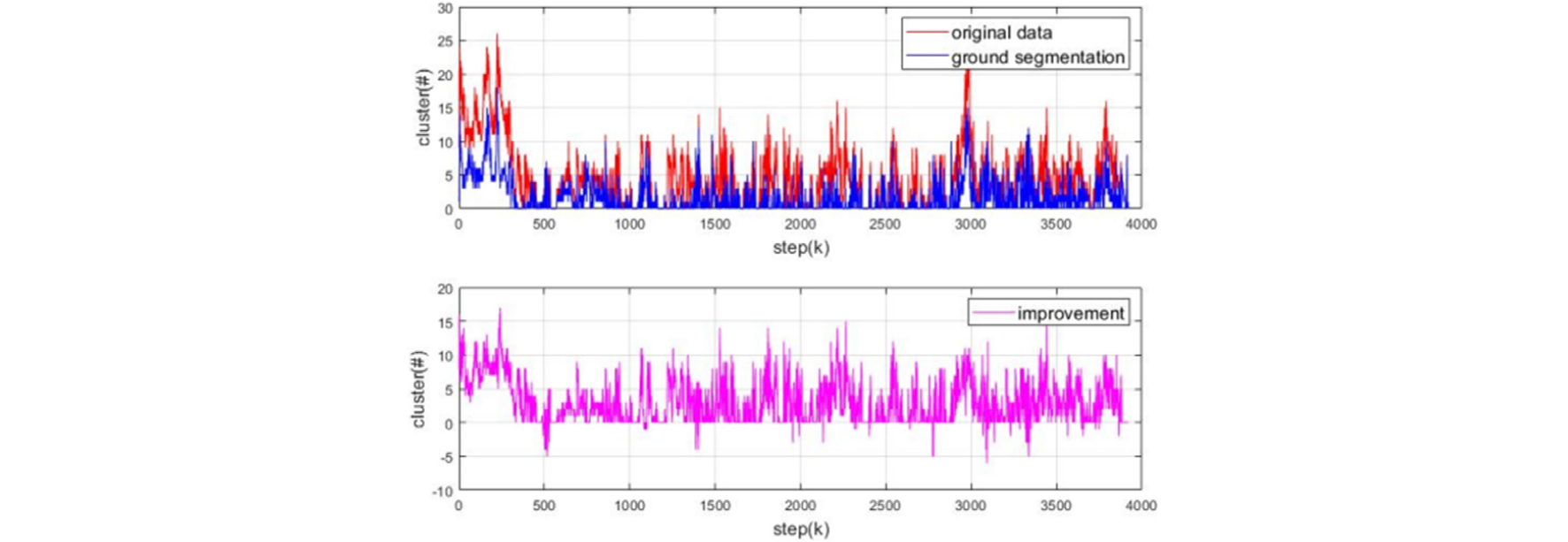

Fig. 7은 차량 전방에 ROI를 설정하여 지면의 점군집 데이터에 대한 클러스터링을 진행한 결과이다. 실험 결과는 Table 4와 같다. 일반적으로 차량 전방의 지면 데이터가 약 4.7314개의 클러스터들로 판단되었는데, 알고리즘 적용 결과 1.7097개로 감소하면서 차량 주행에 있어서 지면 데이터의 영향이 줄어드는 것을 볼 수 있었다. Fig. 3(a)와 (b)의 경우에서도 지면 데이터가 차량 전방에 존재함으로써 하나의 물체로 클러스터링될 수 있다. Fig. 7과 Table 4을 통하여 라이다 센서에서 받은 데이터와 z축 기준 지면 세그멘테이션을 진행했을 때와 비교하여 다수의 클러스터링 개체들을 감소시키는 것을 확인할 수 있다. 클러스터 개선 결과가 음수가 나오는 경우는 점 간 거리 기반으로 데이터 클러스터링을 할 때에 대한 오차라고 보여진다.

5. 결 론

본 연구에서는 차량 전방에서 지면과 센서의 각도 차이가 생길 때 나타나는 라이다 지면 점군집 데이터를 제거하여 인지 성능을 높일 수 있는 알고리즘을 제시하였다. 라이다 데이터에 스캐닝 모형으로 평면 모델을 설정하여 평면으로 예측되는 점군집 데이터들을 제거하였고, 실제 지면 데이터가 제거되면서 제안한 알고리즘이 우수한 필터링 성능을 지님을 확인하였다. 이에 대하여 경사 구간이 많은 서울대학교 캠퍼스 내에서 자율 주행 실험을 진행하여 실시간성을 확보하고 클러스터링을 통해 성능을 분석하였다.

그라운드 세그멘테이션 수행 결과를 라이다에서 지면 추출을 수행하지 않은 원본 데이터를 대조군으로 하여 감소된 점군집 데이터의 개수와 차량 전방에 ROI를 설정해 지면으로 예측되는 점군들로부터 생성된 클러스터의 갯수를 분석하였을 때 실제로 데이터들이 제거되어 기존의 지면 데이터가 하나의 물체로 오인지되는 오르막길, 내리막길 상황에서 지면 데이터가 확인되지 않았고, 지면 데이터를 물체로 인지하지 않아 자율 주행 차량이 급감속하는 문제가 해결됨으로써 차량 인지 성능이 개선되었다.

또한 제안된 알고리즘이 수행되는데 걸리는 시간은 약 1.91ms으로, 전체 자율 주행 차량 알고리즘의 소요시간(150ms)과 인지 알고리즘 소요시간(60ms)에 비추어 보았을 때 굉장히 짧은 시간에 해당한다. 알고리즘 소요 시간과 시각화시킨 결과를 통하여 실시간성을 확보하였고, 해당 알고리즘을 적용하고 자율 주행 시뮬레이션을 수행했을 때 미인지, 오인지에 대한 문제를 현저히 감소시키며 기존보다 우수한 성능을 보임을 확인하였다. 본 알고리즘에서 지면 데이터 분리 시 전체 데이터에 댄일 모델만 적용이 가능하므로, 자율 주행 차량의 인지 범위 내 경사가 반복적으로 존재하거나 심해지는 영역에 대한 알고리즘은 향후 추가 개발되어야 할 것으로 판단된다.